[ad_1]

Chúng tôi khám phá các phương pháp biểu diễn video mới được trang bị khả năng suy luận dạng dài. Đây là phần II tập trung vào việc chuyển đổi văn bản video thưa thớt. Nhìn thấy Phần I trên video dưới dạng đồ thị. Và Phần III cung cấp một cái nhìn sơ lược về những khám phá mới nhất và vĩ đại nhất của chúng tôi.

Các blog đầu tiên trong loạt bài này là về việc tìm hiểu các phương pháp biểu diễn video dựa trên biểu đồ thưa thớt rõ ràng để học cách biểu diễn video “dạng dài”. Chúng là những phương pháp hiệu quả; tuy nhiên, họ không thể đào tạo được từ đầu đến cuối. Chúng tôi cần phải dựa vào CNN hoặc các trình trích xuất tính năng dựa trên máy biến áp khác để tạo ra các phần nhúng nút ban đầu. Trong weblog này, trọng tâm của chúng tôi là nghĩ ra các phương pháp toàn diện bằng cách sử dụng máy biến áp, nhưng có cùng mục tiêu là lập luận “dạng dài”.

Bộ chuyển đổi văn bản video thưa thớt

Là một kiến trúc có thể học được từ đầu đến cuối, chúng tôi bắt đầu khám phá máy biến áp. Câu hỏi đầu tiên mà chúng tôi cần câu trả lời là liệu trình biến đổi văn bản video có học cách mô hình hóa các mối quan hệ thời gian giữa các khung không? Chúng tôi nhận thấy rằng mặc dù có năng lực to lớn và lượng dữ liệu đào tạo đa phương thức dồi dào, các mô hình video gần đây cho thấy xu hướng mạnh mẽ hướng tới các biểu diễn không gian dựa trên khung, trong khi lý luận về thời gian phần lớn vẫn chưa được giải quyết. Ví dụ: nếu chúng ta xáo trộn thứ tự các khung hình video trong đầu vào của các mô hình video thì đầu ra sẽ không thay đổi nhiều!

Sau khi điều tra kỹ hơn, chúng tôi xác định một số thách thức chính trong việc kết hợp lý luận đa khung trong các mô hình ngôn ngữ video. Đầu tiên, kích thước mô hình hạn chế ngụ ý sự đánh đổi giữa việc học theo không gian và thời gian (một ví dụ kinh điển là tích chập 2D/3D trong CNN video). Đối với bất kỳ tập dữ liệu cụ thể nào, hiệu suất tối ưu đòi hỏi sự cân bằng cẩn thận giữa cả hai. Thứ hai, các mô hình video dài hạn thường có kích thước mô hình lớn hơn và dễ bị trang bị quá mức. Do đó, đối với các mô hình video dạng dài, việc phân bổ cẩn thận các tham số và kiểm soát sự phát triển của mô hình trở nên quan trọng hơn. Cuối cùng, ngay cả khi việc kéo dài thời lượng clip sẽ cải thiện kết quả thì nó vẫn có thể bị giảm dần do lượng thông tin được cung cấp bởi một video clip không tăng tuyến tính theo tốc độ lấy mẫu của nó. Nếu kích thước mô hình không được kiểm soát, mức tăng tính toán có thể không chứng minh được mức tăng về độ chính xác. Điều này rất quan trọng đối với kiến trúc dựa trên máy biến áp, vì cơ chế tự chú ý có bộ nhớ bậc hai và chi phí thời gian đối với độ dài đầu vào.

Tóm lại, độ phức tạp của mô hình phải được điều chỉnh một cách thích ứng, tùy thuộc vào video đầu vào, để đạt được sự cân bằng tốt nhất giữa biểu diễn không gian, biểu diễn thời gian, tiềm năng quá mức và độ phức tạp. Do các mô hình văn bản video hiện tại thiếu khả năng này nên chúng đạt được sự cân bằng dưới mức tối ưu giữa mô hình hóa không gian và thời gian hoặc hoàn toàn không học được các biểu diễn thời gian có ý nghĩa.

Những gì có thể được tạo ra “thưa thớt” trong máy biến áp video? Nút và cạnh:

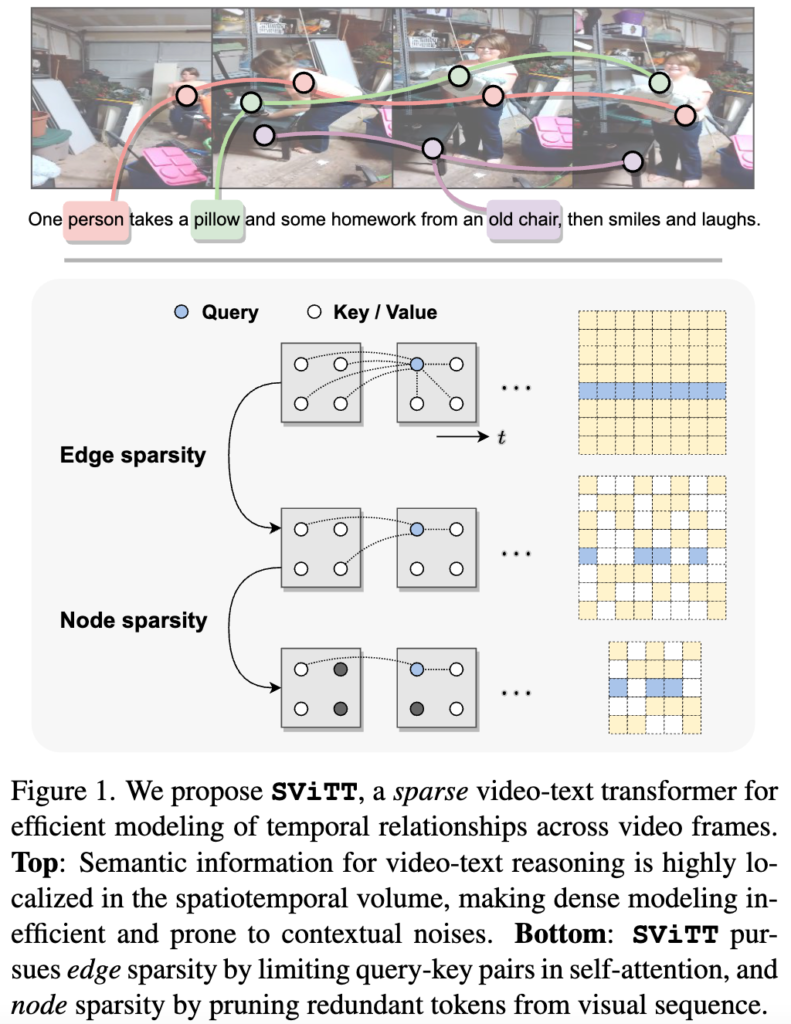

Chúng tôi lập luận rằng các mô hình văn bản video nên học cách phân bổ tài nguyên mô hình hóa cho dữ liệu video. Thay vì mở rộng mô hình một cách thống nhất thành các clip dài hơn, việc phân bổ các tài nguyên này đến các vị trí không gian-thời gian phù hợp của video là rất quan trọng để học tập hiệu quả từ các clip dài. Đối với các mô hình máy biến áp, việc phân bổ này được thực hiện một cách tự nhiên bằng cách cắt bớt các kết nối chú ý dư thừa. Sau đó, chúng tôi hoàn thành những mục tiêu này bằng cách khám phá các kỹ thuật phân tán máy biến áp. Điều này thúc đẩy việc đưa ra một Trình biến đổi văn bản video thưa thớt SViTT lấy cảm hứng từ các mô hình đồ thị. Như được minh họa trong Hình 1, SViTT coi mã thông báo video là các đỉnh của biểu đồ và các mẫu tự chú ý là các cạnh kết nối chúng.

Chúng tôi thiết kế SViTT để theo đuổi tính thưa thớt cho cả hai: Nút sự thưa thớt làm giảm việc xác định các mã thông báo thông tin (ví dụ: tương ứng với các đối tượng chuyển động hoặc người ở phía trước) và cắt bớt các phần nhúng tính năng nền; bờ rìa tính thưa thớt nhằm mục đích giảm các cặp khóa truy vấn trong mô-đun chú ý trong khi vẫn duy trì khả năng suy luận tổng thể của nó. Và, nút sự thưa thớt làm giảm việc xác định các mã thông báo thông tin (ví dụ: tương ứng với các đối tượng chuyển động hoặc người ở phía trước) và cắt bớt các phần nhúng tính năng nền. Để giải quyết vấn đề lợi nhuận giảm dần đối với các clip đầu vào dài hơn, chúng tôi đề xuất đào tạo SViTT với tính năng mở rộng thưa thớt theo thời gian, một chiến lược học tập trong chương trình giảng dạy giúp tăng độ dài clip và độ thưa thớt của mô hình, đồng bộ ở mỗi giai đoạn đào tạo.

kết quả: (1) Bên trái: Mẫu đào tạo bao gồm mô tả (câu ở trên cùng) và một video clip (chuỗi khung hình của video), (2) Giữa: lớp 10 của bộ mã hóa video sau khi cắt bớt mã thông báo trực quan; (3) Phải: Đầu ra của bộ mã hóa đa phương thức sau khi cắt bớt mã thông báo.

Ứng dụng, đánh giá và kết quả

SViTT được đánh giá dựa trên các điểm chuẩn văn bản-video đa dạng, từ truy xuất video đến trả lời câu hỏi, so sánh với nghệ thuật trước đây và các đường cơ sở lập mô hình dày đặc của chúng tôi. Đầu tiên, chúng tôi thực hiện một loạt nghiên cứu cắt bỏ để hiểu được lợi ích của việc lập mô hình thưa thớt trong máy biến áp. Thật thú vị, chúng tôi nhận thấy rằng cả nút (mã thông báo) và cạnh (sự chú ý) đều có thể bị cắt giảm đáng kể khi suy luận, với tác động nhỏ đến hiệu suất thử nghiệm. Trên thực tế, việc lựa chọn mã thông báo bằng cách sử dụng sự chú ý đa phương thức sẽ cải thiện kết quả truy xuất thêm 1% mà không cần đào tạo lại. Hình 2 cho thấy SViTT tách biệt các vùng thông tin khỏi các mảng nền để hỗ trợ lý luận tạm thời hiệu quả.

Tiếp theo, chúng tôi thực hiện đào tạo trước đầy đủ với các mô hình thưa thớt và đánh giá hiệu suất xuôi dòng của chúng. Chúng tôi nhận thấy rằng SViTT có khả năng mở rộng tốt cho các clip đầu vào dài hơn, trong đó độ chính xác của các máy biến áp dày đặc giảm do khó tối ưu hóa. Trên tất cả các điểm chuẩn văn bản video, SViTT báo cáo hiệu suất tương đương hoặc tốt hơn so với các đối tác dày đặc của chúng với chi phí tính toán thấp hơn, vượt trội so với các kỹ thuật trước đó, bao gồm cả những nghệ thuật được đào tạo bằng kho văn bản hình ảnh bổ sung.

Chúng ta có thể thấy từ các bảng trên, với sự phân tán, việc tổng hợp ngữ cảnh theo thời gian ngay lập tức có thể dài hơn gấp 2 lần (bảng 2). Đồng thời xem cách phân tán duy trì độ chính xác của tác vụ cuối cùng (bảng 1), thay vì cải thiện chúng.

Trong bảng trên, chúng tôi chỉ ra cách mô hình đào tạo được đề xuất của chúng tôi giúp cải thiện hiệu suất nhiệm vụ đối với các mức độ thưa thớt khác nhau. Trong bảng 4, bạn có thể thấy hiệu suất của tác vụ truy xuất văn bản thành video trên hai điểm chuẩn tiêu chuẩn.

Cuối cùng, chúng tôi hiển thị kết quả trên các điểm chuẩn khác nhau về truy xuất đa phương thức và trả lời câu hỏi bằng video. SViTT vượt trội hơn tất cả các phương pháp hiện có và thậm chí yêu cầu số lượng cặp đào tạo trước ít hơn.

Thông tin chi tiết về SViTT có thể được tìm thấy đây . Tóm lại, So với các máy biến áp ban đầu, SViTT hiệu quả hơn 6–7 lần, có khả năng tổng hợp ngữ cảnh gấp 2 lần. Đào tạo trước với SViTT cải thiện độ chính xác của SoTA trên 5 điểm chuẩn: truy xuất, VideoQ&A.

SViTT-Ego dành cho video ích kỷ:

Việc đào tạo trước các mô hình ngôn ngữ tầm nhìn lấy cái tôi làm trung tâm đã trở nên cần thiết để cải thiện các tác vụ văn bản video lấy cái tôi làm trung tâm ở hạ lưu. Những mô hình nền tảng tự nhiên này thường sử dụng kiến trúc máy biến áp. Dung lượng bộ nhớ của các mô hình này trong quá trình đào tạo trước có thể rất lớn. Do đó, chúng tôi đào tạo trước mô hình biến đổi văn bản video thưa thớt của riêng mình, SViTT-Ego, mô hình biến đổi văn bản video thưa thớt đầu tiên tích hợp phân mảnh cạnh và nút. Chúng tôi đào tạo trước trên cái tôiClip tập dữ liệu và kết hợp EgoNCE mục tiêu thân thiện với cái tôi, thay vì InfoNCE thường được sử dụng. Đáng chú ý nhất là SViTT-Ego, đạt được mức tăng 2,8% về độ chính xác của EgoMCQ (nội video) so với SOTA hiện tại, không có kỹ thuật tăng cường dữ liệu bổ sung nào ngoài tăng cường hình ảnh tiêu chuẩn, nhưng vẫn có thể huấn luyện trước trên các thiết bị có bộ nhớ hạn chế. Một ví dụ trực quan như vậy được hiển thị dưới đây. Chúng tôi đang chuẩn bị tham gia hội thảo EgoVis tại CVPR với SViTT-ego của chúng tôi.

độ chính xác trong nội bộ video. Khi xem xét các mô hình được đào tạo chỉ trên

3,8 triệu mẫu không có tăng cường tường thuật, đầu ra SViTT-Ego

thực hiện tất cả các mô hình với độ chính xác giữa video và nội bộ video

kết quả với bộ mã hóa tầm nhìn: hàng 1, hiển thị đầu vào 4 khung hình; hàng ngang

2, hiển thị lớp 4 của bộ mã hóa video sau khi cắt bớt mã thông báo trực quan; hàng 3,

hiển thị lớp 7 của bộ mã hóa video sau khi cắt bớt mã thông báo trực quan; và hàng

4, hiển thị lớp 10 của bộ mã hóa video sau khi cắt bớt mã thông báo trực quan. Chúng tôi

theo dõi SViTT để cắt bớt mã thông báo trực quan

Điểm nổi bật:

Chúng tôi đề xuât, SViTT, một kiến trúc văn bản video thống nhất độ thưa thớt của cạnh và nút; Chúng tôi cho thấy tính hiệu quả của mô hình hóa thời gian đối với các tác vụ ngôn ngữ video. So với máy biến áp gốc, SViTT hiệu quả hơn 6–7 lần, có khả năng tổng hợp ngữ cảnh gấp 2 lần. Đào tạo trước với SViTT cải thiện độ chính xác so với SoTA trên 5 điểm chuẩn: truy xuất, VideoQ&A. Tác phẩm biến đổi thưa thớt văn bản video của chúng tôi được xuất bản lần đầu tiên tại CVPR 2023.

Tiếp theo, chúng tôi trình bày cách chúng tôi tận dụng biến áp thưa thớt như vậy cho các ứng dụng hiểu video tập trung. Chúng tôi thể hiện SViTT-Bản ngã (được xây dựng trên SViTT) vượt trội hơn các đường cơ sở của máy biến áp dày đặc trong nhiệm vụ EgoMCQ với yêu cầu điện toán và bộ nhớ tối đa thấp hơn đáng kể nhờ độ thưa thớt vốn có. Điều này cho thấy các kiến trúc thưa thớt như SViTT-Bản ngã là một lựa chọn mô hình nền tảng tiềm năng, đặc biệt là để đào tạo trước trên các thiết bị có bộ nhớ. Hãy đón chờ những tin tức thú vị trong thời gian tới!

[ad_2]

Source link